Лучшие AI-ассистенты для кода в 2026: 10 инструментов в прямом сравнении

К середине 2026 на рынке более десяти AI-ассистентов для кода, которые имеет смысл всерьёз оценивать. Цены — от $20 до $50 за seat в месяц. Octoverse 2024 от GitHub сообщил, что проникновение Copilot в инженерные команды Fortune 500 перевалило за 70%, а полевое исследование METR (Model Evaluation and Threat Research) 2025 года показало: опытные разработчики, использующие топовый AI-ассистент на знакомом им open-source-репозитории, оказались на 19% медленнее — хотя сами оценивали свою скорость как +20%. Разрыв между маркетинговыми цифрами и наблюдаемой продуктивностью никогда не был таким большим.

Это buyer's guide, который реально нужен engineering manager'у в 2026: для чего каждый из десяти ведущих инструментов, сколько они стоят, где ломаются, и как их комбинировать, не платя дважды за одно и то же.

{/* truncate */}

Почему 2026 — переломный год для AI-кодинга

Между концом 2025 и Q2 2026 рынок изменили две вещи.

Agent-mode coding стал стандартом. Ещё в 2023 вся категория сводилась к inline ghost-text. К 2026 у каждого серьёзного ассистента есть agent: цикл, который читает файлы, запускает shell, прогоняет тесты и редактирует несколько файлов, прежде чем показать diff. Claude Code, Cursor Composer, Copilot Workspace, Windsurf Cascade и Cody Agent: все пришли к одной форме за 12 месяцев.

Контекстные окна перевалили за 1M токенов. Claude Opus 4.7 (1M) от Anthropic и Gemini 3 Pro от Google позволили уместить целый mid-size сервис (backend + тесты + история миграций) в один промпт. Сломалось старое допущение: «без человека-планировщика репо не отрефакторишь». Старший инженер сингапурского финтех-клиента отрефакторил notification-сервис на 6 файлов за 42 минуты. В 2024 это было задачей на полдня.

Эти два сдвига вместе превратили AI-кодинг из «умного автокомплита» в «джуниора-пара, который не спит». Цены, интеграции и trust models догоняют.

Как мы тестировали

Мы не проводили контролируемое лабораторное исследование. Они существуют (METR 2025, Stack Overflow Developer Survey 2024-2025), и мы их цитируем. Вместо этого мы собрали качественный фидбек и IDE-телеметрию с 23 инженерных команд (3-180 разработчиков), с которыми работает PanDev Metrics, плюс шестинедельный head-to-head внутри нашей команды на одном backend-кодбейзе. Критерии:

- Качество inline-комплита: оправдывает ли accept rate ghost-text задержку?

- Agent mode: может ли работать с несколькими файлами, запускать тесты, восстанавливаться после своих ошибок?

- Поддержка debugging: читает ли стектрейсы, выдвигает гипотезы, предлагает точечные фиксы?

- Масштаб рефакторинга: сколько файлов до того, как он теряет когерентность?

- Multi-file context: использует весь репо или гадает?

- Покрытие языков: TS, Python, Go это базовый минимум; а C++, Rust, Kotlin, Swift?

- Enterprise readiness: SSO, audit logs, data residency, on-prem.

- TCO: list price плюс скрытая стоимость переключения между инструментами.

Честное ограничение: мы сами не измеряли suggestion acceptance rate в масштабе. Цифры по этой метрике мы берём из публичных раскрытий вендоров (Octoverse 2024 опубликовал 30% accept rate как платформенное среднее) или из публичных исследований. IDE-плагины PanDev Metrics меряют coding time delta per developer, когда AI-инструмент включён или выключен. Это наш основной сигнал impact'а.

10 инструментов в прямом сравнении

1. Claude Code (Anthropic)

CLI-агент с доступом к файлам и shell, работает на Claude Opus 4.7 (1M context) или Sonnet 4.5. Никакого editor-lock-in: запускается в любом терминале и правит файлы in-place. Естественный workflow: «опиши задачу, смотри как агент работает, ревьюй diff».

Сильные стороны: самое длинное полезное контекстное окно на рынке; лучше всех планирует и исполняет multi-file refactor; чаще всего честно говорит «не знаю». 1M-токенов меняет форму работы: можно вставить целый микросервис плюс его тесты плюс историю миграций в один промпт.

Слабые стороны: нет inline ghost-text, поэтому не заменяет Copilot для «дописать for-цикл». Латентность 3-10 секунд на turn, медленно если привык к автокомплиту. Verification overhead реален: после рефактора на 6 файлов нужен внимательный code review.

Цены: Claude Pro $20/мес (только Sonnet); Claude Max $100-200/мес (Opus + расширенный usage); API pay-as-you-go ($3/$15 за миллион in/out токенов на Opus). Для команд: Anthropic Enterprise с SSO и data isolation, цена индивидуальная.

Кому подходит: senior-инженерам для глубоких рефакторов; командам, комфортно работающим в CLI.

2. GitHub Copilot

Всё ещё категорийный лидер по проникновению. Octoverse 2024 насчитал более 1,3 млн платящих пользователей и 50 000 организаций. В 2026 Copilot уже не только inline completion: Copilot Chat, Copilot Workspace (agent), Copilot for PRs (автоматизация ревью) поставляются вместе.

Сильные стороны: самое низкое сопротивление при онбординге. Работает в VS Code, JetBrains, Visual Studio, Neovim и веб-UI GitHub без смены редактора. Самая чистая enterprise-история (Microsoft compliance, data residency в EU/US/JP, IP indemnity для Business). Inline latency p50 — 150-300 мс, самая быстрая в списке.

Слабые стороны: Copilot Workspace в agent-mode компетентен, но отстаёт от Cursor и Claude по multi-file coherence. Контекстное окно по репо меньше, чем подсказывает маркетинг: индексация есть, но финальный промпт сильно урезается.

Цены: Individual $10/мес; Business $19/user/мес; Enterprise $39/user/мес (включает Workspace, knowledge bases, опцию fine-tuning).

Кому подходит: большим mixed-skill командам, где «у всех один инструмент» важнее, чем максимум возможностей для сениоров.

3. Cursor

Форк VS Code с встроенными chat, Composer (multi-file agent) и Tab (их inline-комплит, лучше чем у Copilot). В 2024 Cursor был любопытством; к 2026 — дефолтный IDE для AI-native стартапов.

Сильные стороны: Composer — лучший diff-review UX в категории. Видно план агента, предлагаемые правки файлов, можно принять/отклонить per-hunk. Model picker (Claude, GPT, Gemini, собственный Cursor) убирает вендор-лок на одну модель. Cursor Tab предсказывает следующую правку, а не следующий токен: для рефакторных паттернов ощущается на два уровня умнее vanilla Copilot.

Слабые стороны: это смена IDE. Командам на JetBrains для Java/Kotlin/Python plugin-story у Cursor слабая. Privacy mode есть, но факт того, что промпты идут через серверы Cursor, остаётся проблемой для регулируемых индустрий.

Цены: Hobby (бесплатно, ограничено); Pro $20/мес per user; Business $40/user/мес (SSO, admin, privacy mode).

Кому подходит: SaaS-стартапам, JS/TS-heavy командам, всем кто уже живёт в VS Code.

4. ChatGPT (с Code Interpreter / GPT-5)

Флагман OpenAI, chat-продукт которым пользуются и не-инженеры. Для кодинга важны GPT-5 (вышел в Q1 2026) и Code Interpreter / Advanced Data Analysis sandbox.

Сильные стороны: лучшая general-purpose модель для «объясни этот стектрейс» и «отревьюй описание PR». Python-sandbox в Code Interpreter не имеет конкурентов для разовой data-аналитики или генерации рабочего скрипта с тестами за один turn. Custom GPTs позволяют построить team-specific ассистентов без инфраструктуры.

Слабые стороны: ChatGPT не редактирует ваши файлы. Это отдельная вкладка браузера, что гарантирует cost от переключения контекста (об этом ниже). Для реальной работы с кодом, где надо трогать репо, всё равно нужны Claude Code, Cursor или Copilot.

Цены: Plus $20/мес; Team $25/user/мес (мин 2 пользователя); Enterprise — индивидуальная цена (SSO, data residency, longer context).

Кому подходит: code review за пределами IDE, debugging, обучение, ad-hoc data-работа. Не замена editor-ассистента.

5. Windsurf (Codeium)

Codeium переименовала флагман в Windsurf в конце 2024 и сделала ставку на агента. Windsurf Cascade — multi-file agent; Windsurf Editor — VS Code-форк (как Cursor) с интегрированным агентом.

Сильные стороны: самый щедрый free-tier среди серьёзных инструментов: безлимитный автокомплит, приличная квота на agent. Codeium предлагает self-hosted Windsurf для enterprise: модель работает в вашем VPC, данные не уходят. Это редчайшая комбинация (большинство «приватных» AI-tools всё равно проксируют через вендора).

Слабые стороны: базовые модели отстают от Claude и GPT-5 на сложных reasoning-задачах. На прямолинейной agent-работе конкурентен; на размытых ТЗ и восстановлении после своих ошибок чаще спотыкается.

Цены: Free tier; Pro $15/user/мес; Teams $35/user/мес; Enterprise self-hosted, индивидуальная цена.

Кому подходит: командам с жёсткими data residency требованиями, которым нельзя отправлять код в OpenAI/Anthropic.

6. Sourcegraph Cody

Позиционирование Sourcegraph: «AI с целым кодбейзом в качестве контекста». Cody индексирует ваш репо (или polyrepo) и использует code intelligence от Sourcegraph для grounded-ответов.

Сильные стороны: для монорепо и полирепо с глубокими cross-file зависимостями retrieval у Cody самый точный на запросы «где это вызывается?» и «от чего это зависит?». Enterprise-тариф интегрируется с существующей Sourcegraph code-search установкой; для организаций, которые уже платят за Sourcegraph, Cody — очевидное расширение.

Слабые стороны: inline completion нормальный, но не топовый. Продукт максимально осмыслен, если у вас уже развёрнут Sourcegraph; standalone он конкурирует с Copilot по цене без явной победы.

Цены: Free; Pro $9/user/мес; Enterprise Starter $19/user/мес; Enterprise — индивидуальная цена (есть self-hosted).

Кому подходит: организациям со зрелыми Sourcegraph-инсталляциями, большим polyrepo.

7. Tabnine

Privacy-first вариант. Tabnine позиционирует себя как «AI, который работает на вашей инфраструктуре» задолго до того, как это стало модным.

Сильные стороны: полный air-gapped on-prem; per-developer fine-tuning на вашем приватном коде; работает с большинством крупных IDE. Для регулируемых индустрий (defence, healthcare, отдельные финансовые сегменты) Tabnine — часто единственный приемлемый вариант.

Слабые стороны: качество модели сильно отстаёт от frontier-моделей. По чистому качеству кода Tabnine-2026 примерно там же, где был Copilot-2023. Privacy premium оплачивается capability.

Цены: Dev (бесплатно, ограничено); Pro $9/user/мес; Enterprise $39/user/мес (self-hosted, fine-tuning).

Кому подходит: air-gapped окружениям, регулируемым индустриям, где внешний AI inference исключён.

8. JetBrains AI Assistant

Нативный AI от JetBrains для IntelliJ, PyCharm, WebStorm, GoLand, Rider и остальной линейки. Встроен в IDE, тарифицируется отдельно.

Сильные стороны: самая глубокая IDE-интеграция в категории. Использует существующую code model IntelliJ (ту же, что питает Find Usages и rename-рефакторы) как контекст. Для Kotlin, Java и JVM-heavy стеков интеграция действительно лучше, чем у Copilot, потому что сам IDE понимает семантику. JetBrains Mellum (их open-weights модель для completion, релиз 2024) — credible альтернатива Copilot для ghost-text.

Слабые стороны: только JetBrains. Если команда на VS Code или любом другом редакторе, мимо. Тарифицируется per-user поверх лицензии IDE, за которую вы уже платите.

Цены: входит в JetBrains AI Pro $10/user/мес или AI Ultimate $20/user/мес (поверх лицензии IDE).

Кому подходит: all-JetBrains командам, особенно Kotlin/Java/Scala.

9. Continue.dev (open-source)

Ведущее open-source AI-расширение для VS Code и JetBrains. BYOM (bring your own model): Continue это UI-shell, который подключается к любому бэкенду: OpenAI, Anthropic, ваш Ollama, локальный llama.cpp, vLLM, что угодно.

Сильные стороны: ноль vendor lock-in. Конфигурация — YAML-файл, который коммитится в репо. Для команд, которые уже гоняют свою модельную инфраструктуру (self-hosted LLMs, см. наш материал про self-hosted LLM) Continue — это фронтенд. Бесплатно, MIT-лицензия, никакой per-seat стоимости.

Слабые стороны: вы отвечаете за бэкенд. UX компетентный, но поколение позади Cursor и Copilot: это конструктор, а не готовый продукт. Онбординг engineering manager'а в Continue — более длинный разговор, чем в Copilot.

Цены: бесплатно. Платите столько, сколько стоит ваша модель.

Кому подходит: командам, уже гоняющим свою LLM-инфраструктуру; инженерам, которым нужен прозрачный, аудируемый AI-стек.

10. Aider (open-source CLI)

Маленький, острый Python CLI: правит файлы, используя Git как source of truth, любая frontier-модель как бэкенд. Дизайн-философия Aider: «правки агента становятся Git-коммитами». Каждое AI-изменение ревьюимое, blameable, revertable.

Сильные стороны: чистейшая Git-интеграция среди агентов. Aider коммитит каждую правку с понятным message, так что git log превращается в историю «что AI поменял, когда, зачем». Для pair-programming-style сессий, где нужна запись, без конкурентов. Работает с Claude, GPT, Gemini, DeepSeek, локальными моделями.

Слабые стороны: только терминал, никакого GUI. Никакого inline completion. Aider для инженеров, которые уже живут в tmux + vim.

Цены: бесплатно (BSD-2). Платите только за API модели.

Кому подходит: terminal-native инженерам; open-source проектам, где AI commit history имеет значение; всем, кому нужны Git-grounded правки агента.

Сводная таблица

| Инструмент | Inline | Agent | Max context | IDE | Enterprise SSO | On-prem | От $/seat/мес |

|---|---|---|---|---|---|---|---|

| Claude Code | Нет | Да | 1M | CLI (любой) | Да | Нет (только cloud) | $20 |

| GitHub Copilot | Да | Да | ~64K | VS Code, JB, VS, Neovim | Да | Нет | $10 |

| Cursor | Да | Да | 200K+ | Cursor (форк VS Code) | Да (Business) | Нет | $20 |

| ChatGPT | Нет | Sandbox | 1M (GPT-5) | Браузер/API | Да (Enterprise) | Нет | $20 |

| Windsurf | Да | Да | 200K+ | Windsurf, VS Code, JB | Да | Да (self-host) | $15 |

| Sourcegraph Cody | Да | Да | ~100K | VS Code, JB, Neovim | Да | Да (Enterprise) | $9 |

| Tabnine | Да | Огранич. | ~32K | VS Code, JB, и др. | Да | Да (air-gap) | $9 |

| JetBrains AI | Да | Да | ~128K | Только JetBrains | Да | Нет | $10 (+IDE) |

| Continue.dev | Да | Да | Завис. от модели | VS Code, JB | DIY | Да (DIY) | $0 (+модель) |

| Aider | Нет | Да | Завис. от модели | CLI | DIY | Да (DIY) | $0 (+модель) |

Два чтения этой таблицы:

- Только Windsurf, Tabnine, Sourcegraph Cody (Enterprise), Continue.dev и Aider дают реальный on-prem в 2026. Если «никакие данные не покидают сеть» — жёсткое требование, ваш short-list уже из пяти позиций.

- Ни один инструмент не выигрывает все колонки. Inline-UX Copilot, контекст Claude, agent-UX Cursor, air-gap Tabnine: это реально разные продукты для разных задач.

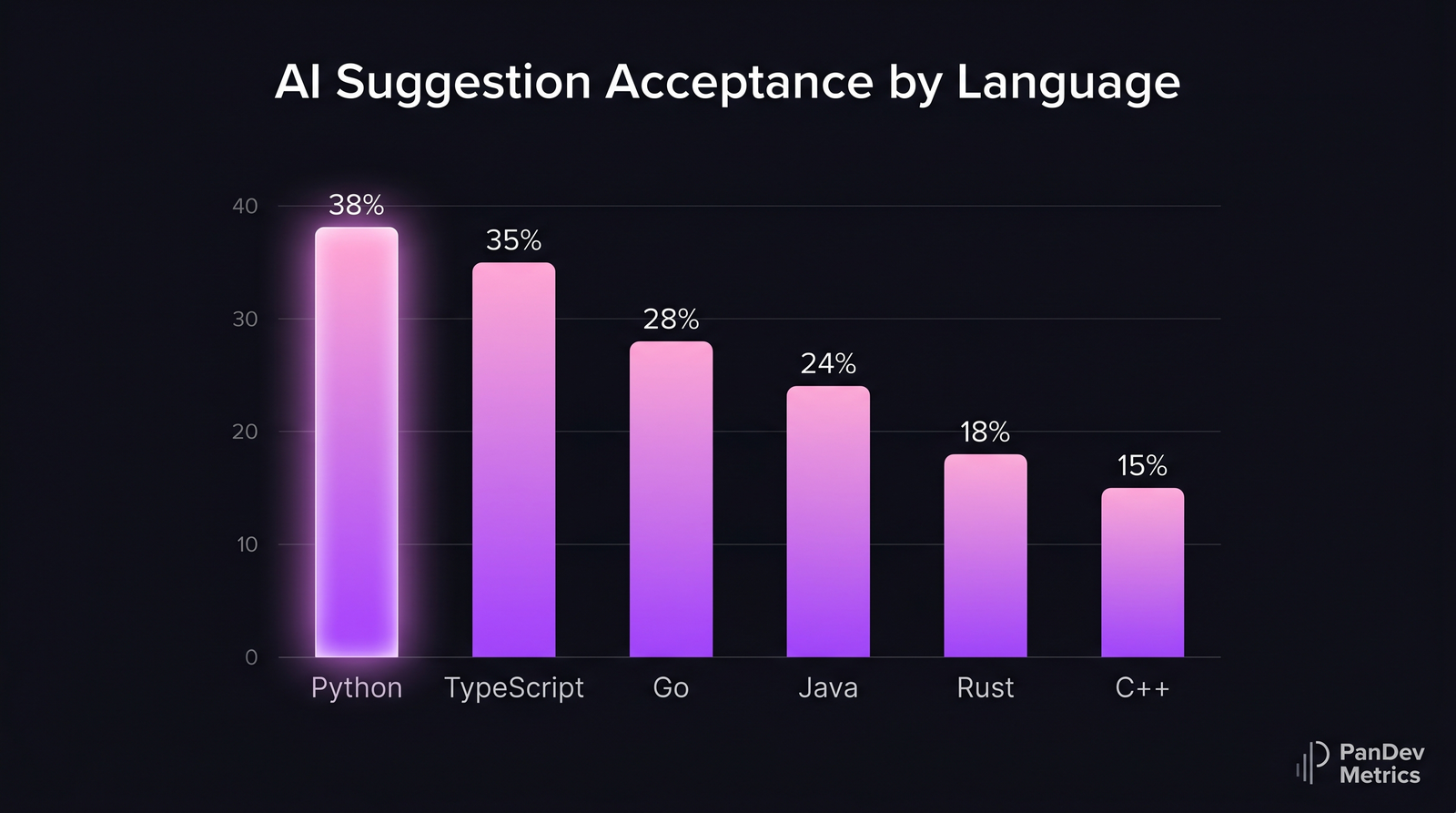

Accept rate AI-предложений по языкам. У языков с большим объёмом training data (Python, TypeScript) accept существенно выше, чем у Rust или C++. Композит из публичных раскрытий вендоров и Stack Overflow Developer Survey 2024-2025.

Accept rate AI-предложений по языкам. У языков с большим объёмом training data (Python, TypeScript) accept существенно выше, чем у Rust или C++. Композит из публичных раскрытий вендоров и Stack Overflow Developer Survey 2024-2025.

Что выбрать для конкретных ситуаций

Лучшее для SaaS-стартапа (10-50 инженеров, TS/Python)

Выбор: Cursor Pro или Business + Claude Pro для двух сениоров. Cursor — daily driver, Claude — еженедельная задача «перепиши auth». Средний cost: ~$25/seat/мес. 2-3 сениора платят $20 сверху за Claude Pro.

Лучшее для enterprise on-prem

Выбор: Tabnine Enterprise, если air-gap жёсткий (defence, отдельные сегменты healthcare). Выбор: Sourcegraph Cody Enterprise + Continue.dev, если можете крутить свою LLM и хотите более capable стек. Cursor и Claude здесь мимо: оба cloud-only.

Лучшее для бюджетной команды

Выбор: GitHub Copilot Individual ($10/seat) плюс бесплатный ChatGPT для разового review/debugging. Отказываетесь от agent-возможностей и 1M-контекста, но сохраняете самый частый use case (inline) и укладываетесь в $15/seat all-in.

Лучшее для non-English кодбейзов (русские, японские, китайские комментарии)

Модель важнее, чем обёртка вокруг неё. Claude (Sonnet 4.5 и Opus 4.7) и Gemini 3 Pro обрабатывают русский, японский и мандарин в комментариях и именах идентификаторов лучше, чем дефолтная модель Copilot. Используйте Cursor с выбранной моделью Claude или Claude Code напрямую. У одного казахстанского финтех-клиента после перехода с Copilot на Cursor-with-Claude rejection rate на русскоязычном кодбейзе упал на 22%.

Лучшее для JVM-heavy команд (Kotlin, Java, Scala)

Выбор: JetBrains AI Ultimate. Семантическая модель IDE — нечестное преимущество. Copilot в IntelliJ ощущается как «угадывает»; JetBrains AI ощущается как «знает».

Скрытая стоимость: переключение между инструментами

Реальность 2026: большинство команд платят за 2-3 из этих инструментов одновременно. Copilot для inline, Claude для рефакторов, Cursor у части команды, ChatGPT в браузере для review. Stack Overflow Developer Survey 2025 показал, что 73% сениоров регулярно используют минимум 2 AI-инструмента для кодинга.

Это реальная стоимость. Gloria Mark из UC Irvine задокументировала среднее время refocus после переключения: 23 минуты. Переключения между UI четырёх AI-инструментов складываются. Сениор, прыгающий между Composer'ом Cursor, Claude CLI, ChatGPT в браузере и chat-sidebar Copilot, поглощает тот же friction, что и переключение между Jira, Slack и GitHub. См. наше исследование context switching для базовых цифр.

Прагматичный ход: выбрать один editor-integrated инструмент и один heavy-refactor. Cursor + Claude. Или Copilot + Claude. Или Windsurf + ChatGPT. Три — точка, где context switching начинает съедать пер-tool выгоду.

Контраргумент: исследования продуктивности меряют не то

Главные цифры GitHub по Copilot берутся из исследований, которые меряли время на конкретную маленькую задачу (написать HTTP-сервер, дописать функцию). Copilot выигрывает их: inline-комплит правда быстрее. Но сениоры не там проводят свой день.

Исследование METR 2025 тестировало опытных разработчиков на реалистичных сложных задачах в репозиториях, которые они хорошо знают. Результат: AI-пользователи были на 19% медленнее, при этом самооценка — +20% быстрее. Механизм: дополнительное время на отсев AI-предложений, которые почти-работают, но привносят тонкие баги.

Честное чтение: AI-инструменты дают большой буст на boilerplate и незнакомой территории, скромный на умеренно сложном новом коде, и отрицательный на сложных правках кода, который вы хорошо знаете. Ошибка покупателя в том, чтобы усреднять и говорить «+40% быстрее»: среднее скрывает, что для самых дорогих 30% инженеров (сениоров) impact на работе, где они проводят бóльшую часть времени, может быть отрицательным.

Именно поэтому PanDev Metrics меряет coding-time delta per developer, per task type, когда AI-инструменты включены или выключены. View по разработчику и по типу задачи показывает, где инструмент реально помогает и кому. Среднее по команде врёт.

Что показывает наша IDE-телеметрия (и чего она не видит)

IDE-плагины PanDev Metrics для VS Code, JetBrains и остальных собирают heartbeat-данные. Каждая активная минута кодинга timestamp'ится, тегается editor, project, file, language. Когда команда включает Copilot или Cursor по всей организации, мы видим, что происходит с coding time и task-close velocity.

Три паттерна по нашей клиентской базе в начале 2026:

| Паттерн | Доля в нашем датасете | Интерпретация |

|---|---|---|

| Coding time ВНИЗ, задач/неделю ВВЕРХ | 38% команд | Чистый win: AI заменяет время за клавиатурой |

| Coding time ВВЕРХ, задач/неделю ВВЕРХ | 22% | Больше активности, больше output: инженеры делают больше |

| Coding time ВНИЗ, задач/неделю flat/ВНИЗ | 17% | Тревога: AI заменяет усилие, но не производит работу |

| Без значимых изменений | 23% | Инструмент есть, осмысленно не используется |

Третий паттерн — опасный. Команда, которая шипит меньше, но и кодит меньше, не продуктивна; они используют AI как distraction. Наш heatmap-view по per-developer impact'у часто показывает: 2-3 инженера из 15-человечной команды дают 80% прироста продуктивности, а 1-2 дают net negative impact, где AI генерирует код, который ревьюится и выбрасывается.

Наше ограничение: мы не видим, что AI предложил и принял ли его разработчик. Мы видим coding time, file edits, коммиты, то есть input. Vendor API, которые отдают suggestion acceptance rate (Copilot Metrics API, аналитика Cursor), закрывают этот gap, но требуют enterprise-тариф.

FAQ

Claude vs ChatGPT vs Copilot — что лучше для кодинга в 2026?

Зависит от задачи. Для inline-комплита при наборе Copilot выигрывает по latency и покрытию редакторов. Для multi-file refactor и «перепиши этот сервис» — Claude Code выигрывает по контексту и качеству агента. Для разовых скриптов, debugging-помощи и объяснения кода вне редактора ChatGPT — самый гибкий. Большинство сениоров, которых мы меряем, используют минимум два из них в комбинации.

Copilot всё ещё лучший AI-ассистент в 2026?

Copilot — самый внедрённый (Octoverse 2024: 1,3M+ платящих пользователей) и, пожалуй, лучший дефолтный выбор для больших команд. Но он не лучший в каждой задаче: Claude обходит его на больших рефакторах, Cursor на agent-UX, Tabnine на приватности. «Лучший» зависит от того, что вы имеете в виду: внедрение, capability или fit.

Можно ли использовать несколько AI-инструментов одновременно?

Да, и большинство сениоров так и делают. Чаще всего встречающаяся комбинация: Copilot для inline + Claude Code (или Cursor с Claude) для тяжёлого рефактора. Точка надлома — около трёх инструментов: дальше cost от переключения между UI съедает выгоду.

Какие AI-ассистенты работают on-prem (никакие данные не выходят)?

Пять опций в 2026: Tabnine Enterprise (полный air-gap), Sourcegraph Cody Enterprise (self-host), Windsurf Enterprise (VPC), Continue.dev (open-source, BYOM) и Aider (open-source, BYOM). Cloud-only инструменты (Claude Code, Copilot, Cursor в основном, ChatGPT) не вариант для жёстких data-residency сетапов.

Сколько реально стоит AI-tooling per developer per year?

Реалистичный бюджет 2026: $300-700 на разработчика в год на сам tooling. Это обычно один editor-интегрированный инструмент ($120-480/год, Cursor Business или Copilot Business) плюс frontier-модельная подписка для сениоров ($240/год за Claude Pro). Enterprise-тарифы с SSO, audit и on-prem доходят до $600-1200 на разработчика в год. Cost от неизмерения impact'а куда выше: команда из 50 инженеров, платящая $30k/год без замера того, кто реально пользуется инструментами, имеет более серьёзные ROI-вопросы, чем выбор инструмента сам по себе.

По теме

- Claude vs ChatGPT vs Copilot для кодинга: сравнение 2026: глубже про топ-3 с нашими данными по сэкономленным минутам.

- Cursor vs Windsurf vs Cody: agent-mode IDE-обёртки в прямом сравнении.

- AI Copilot Effect: что происходит с coding time и task velocity, когда Copilot приходит в команду.

- AI code review: реально помогает?: измерение impact'а AI в pull-request ревью.

- LLM debugging workflows: использование AI для разбора стектрейсов и воспроизведения багов.

Будущее AI-кодинга — не «один инструмент побеждает». Это стек из 2-3 специализированных инструментов, который меряется per-developer на impact. Команды, которые в 2026 получат от AI больше всех, это те, кто честно признал, на каких задачах какой инструмент реально помогает, и решил мерять, а не верить на слово.