DEI-метрики в инженерии: дальше найма

Публичная компания X выбила DEI-цель 2023 по инженерии: 28% женщин в инженерной команде, рост с 21%. Через два года цифра откатилась к 22%. Найм продолжал работать; retention — нет. Постмортем нашёл три паттерна, которых не было в исходной программе: заниженные промоушены женщин с tenure 2-4 года, выше-среднее code review rejection у представителей under-represented групп и assignment bias в «glue work», который не идёт в промоушен.

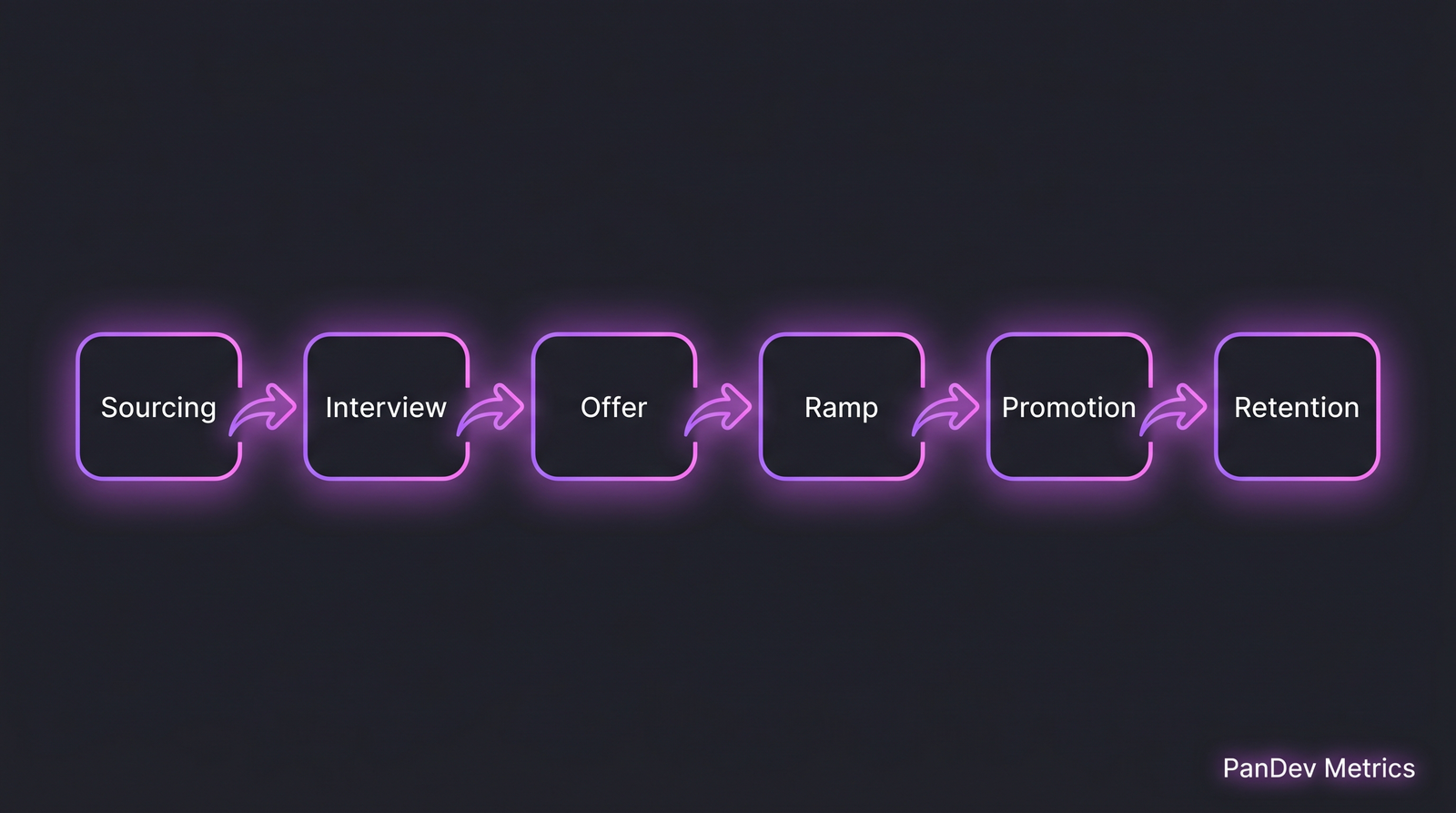

Большинство DEI-программ в инженерии перестают мерить на верху воронки. Числа найма публичные, собираются легко, под них удобно ставить KPI. А что происходит после выхода — скорость промоушенов, цикл ревью, паттерн назначений — вот где живёт культура. И там программы тихо проваливаются или побеждают — часто без ведома менеджмента, пока не накопятся exit-интервью.

{/* truncate */}

Проблема: DEI-айсберг

Видимая десятая часть — найм. Скрытые девяносто — всё ниже по воронке:

- Опыт onboarding

- Retention первого года

- Паттерны code review

- Распределение задач (feature vs glue vs on-call)

- Скорость промоушенов

- Время ухода и заявленные причины

- Представленность на уровнях 5+

Harvard Business Review 2023 (Ellen Kossek, Rebecca Thompson): 76% корпоративных DEI-программ трекают только найм и представленность, и менее 20% трекают скорость промоушенов по демографии — метрику, которая реально предсказывает представленность через 5 лет. Нельзя улучшать то, что не меряешь; этот gap превращает DEI в отчётную дисциплину.

GitHub Octoverse 2024 добавляет точку: code review rejection rate у контрибьюторов из under-represented групп на 8-15% выше baseline в open-source проектах. Эффект реплицируется во внутренних enterprise-данных, если команды гоняют анализ — большинство не гоняет.

Шесть стадий, каждая — фильтр. Цифры найма меряют первые три. Культура живёт в последних трёх.

Шесть стадий, каждая — фильтр. Цифры найма меряют первые три. Культура живёт в последних трёх.

8 метрик, которые рассказывают настоящую историю

По убыванию предсказательной силы для реальной инклюзии:

1. Retention первого года по группам

Что: процент новичков, оставшихся через 12 месяцев, разбитых.

Почему важно: наняли 30% женщин, через год осталось 18% — вы работаете как high-churn фабрика. Воронка шире сверху, но дырявее basline.

Бенчмарк: индустриальная first-year attrition ~20%. Разница >5 п.п. между группами — сигнал тревоги.

2. Скорость промоушенов (time at level) по группам

Что: медиана между промоушенами, разбитая.

Почему важно: эффект «сломанной ступеньки». McKinsey Women in the Workplace 2024: женщин в tech промотят с L3 на L4 в 0.82× раза реже мужчин — и эта одна дельта компаундится в gap представленности на L6+.

Бенчмарк: разницы >15% — повод действовать; >30% — срочный сигнал.

3. Code review acceptance rate по автору

Что: доля PR, принятых на первом ревью, разбитая.

Почему важно: ловит unconscious-bias в ежедневном ревью-цикле. Требует аккуратной анонимизации — не стройте дашборд с именами.

Бенчмарк: разница <5% — норма; >10% — gap, часто указывающий на конкретных ревьюеров.

4. Доля feature work vs glue work в назначениях

Что: распределение «glue work» (координация, доки, тесты, менторинг, incident triage) vs feature work по человеку.

Почему важно: исследование Tanya Reilly (The Staff Engineer's Path, 2024): женщины и меньшинства берут на себя в 1.4-2.0× больше glue work. Glue work не считается в промоушен, и это компаундится с дельтой скорости промоушенов.

Бенчмарк: распределение должно быть пропорционально; большие дельты — bias.

5. Разница оценок интервью в панелях с разным составом

Что: сравнение offer-yes ratings по интервьюерам. Оценивает ли панель с under-represented интервьюером кандидатов иначе?

Почему важно: разнообразные панели — best practice. Реальный тест — меняют ли они outcomes у вас.

6. Компрессия зарплатного диапазона на entry-level

Что: вариация зарплат внутри одного уровня по группам.

Почему важно: недопредставленность часто начинается с переговоров по оферу. Кто принял первый офер — стартует с пола; кто поторговался — выше. Через 3 года это компаундится.

Бенчмарк: <3% вариации внутри уровня — здорово; >8% — bias в outcomes переговоров.

7. Sponsorship и видимость проектов

Что: кто занят на high-visibility проектах за скользящие 12 месяцев.

Почему важно: не менторинг, а sponsorship двигает промоушен. Обеспечение того, что under-represented инженеры пропорционально участвуют в executive-visible проектах, — одно из немногих прямо двигающих gap промоушенов.

8. Причины ухода и распределение tenure

Что: почему уходят и через какой срок. Разбито.

Почему важно: exit-интервью — lagging indicator, но всё ещё полезны. Если under-represented уходят на году 2 с формулировкой «нет роста» — у вас проблема в середине воронки.

Сбор данных без вреда

У DEI-измерений есть этика. Четыре правила:

| Правило | Почему |

|---|---|

| Добровольная самоидентификация | Принудительное раскрытие разрушает доверие |

| Только агрегатная отчётность (n >= 5) | Избегает реидентификации |

| Разбивать по нескольким осям осторожно | Пересечения дают малые ячейки; риск реидентификации |

| Разделить данные и решения | Аналитик, гоняющий числа, не должен решать промоушены |

Здесь помогает enterprise-grade tenancy модель — контроль доступа на уровне департаментов, audit-логи, корректность tenant-timezone для глобальных команд. Наш on-premise деплой часто выбирают именно потому, что HR-adjacent данные не могут покинуть периметр по compliance.

Шаблон программы: как выглядит рабочий DEI-дашборд

Минимальный месячный отчёт, измеримый в любом современном engineering-стеке:

| Секция | Метрики |

|---|---|

| Воронка | Заявки по источникам, % прохождения интервью, offer rate, accept rate (по группам) |

| Onboarding | Time-to-first-PR, time-to-first-ship, 30/60/90 день retention |

| Цикл ревью | PR cycle time, first-review acceptance, медианное число ревьюеров |

| Назначения | Доля feature vs glue work, справедливость on-call ротации |

| Рост | Скорость промоушенов, staffing на cross-team проектах |

| Отток | 12-месячный, 24-месячный retention; распределение категорий ухода |

Гоняйте отчёт ежеквартально, разбивайте при n ≥ 5, давайте лидерству ежемесячно. Агрегированные тренды — команде раз в квартал. Индивидуальные данные — никогда не шарить.

Типовые ошибки

- Только отчётность по найму. Самая громкая метрика — наименее предсказательная для культуры.

- Разбивка по одной оси. «Женщины в инженерии» без разбивки по роли, уровню, tenure прячет реальную историю.

- Публичные индивидуальные данные. Внутренний дашборд с именами создаёт карьерный риск для under-represented и юридический — для компании.

- «Diversity = проблема найма». Найм может сдвинуть верх воронки на 30%; retention и промоушены двигают низ на 100%. Математика не близко.

- Квоты без изменения процесса. Одноразовое попадание в таргет не чинит машину, создавшую gap. Year-2 attrition съест прирост.

Где вписывается PanDev Metrics, осторожно

PanDev Metrics не несёт демографические поля по умолчанию — HR-данные в вашей HRIS, не у нас. Где мы помогаем — с инженерной стороной метрик, которые питают DEI-анализ после join с HR:

Сигнал справедливости назначений. Через распределение проектов и worklog видно, кто делает feature vs ревью vs координацию. Комбинированно с HR (на вашей стороне) — метрика 4 без self-report.

Вход в скорость промоушенов. Tenure, output, visibility проектов + ваши HR-промоушены → метрика 2. Наша сторона — инженерная; HR — событие промоушена.

Code review acceptance (анонимно). Агрегированный PR acceptance и распределение ревьюеров при кросс-cut с HR-демографией на агрегате (n ≥ 5) — метрика 3.

Намеренный выбор: мы не держим чувствительные данные. Мы даём инженерный сигнал, делающий чувствительные данные actionable. Это согласуется с нашим подходом метрики без токсичности — одни и те же данные, используемые по-разному, дают разные культуры. Для базового набора — 10 метрик каждого EM.

Контринтуитивный тезис: bias можно измерить без дашборда

Команды зацикливаются на DEI-дашборде до того, как сделали хоть один одноразовый анализ. Прогоните эти три анализа руками на своих данных:

- 12 месяцев PR. Посчитать first-review acceptance по авторам, анонимно. Посмотреть хвосты распределения.

- 12 месяцев промоушенов. Посчитать медианное tenure-at-level по группам. Посмотреть gap.

- Последние 20 «heroic» response на инциденты. Кто там был. Посмотреть на overrepresentation.

Если эти три анализа ничего не вскрывают — у вас, вероятно, нет измеримого gap сегодня. Если вскрывают — у вас есть история, чтобы обосновать программу. Дашборд опционален; первый анализ — нет.

Честный лимит

Наша платформа сама по себе не даёт демографическую аналитику; кросс-cut'ы выше предполагают, что HRIS-данные либо join'атся внешне, либо остаются у вас. Cifры effect-size (Octoverse 8-15%, McKinsey 0.82×) — из цитируемого публичного исследования, не из нашей телеметрии. Мы не имеем cross-identity данных, чтобы валидировать это на своей клиентской базе, и не изобретаем числа там, где сигнала нет.

DEI также культурно-специфично. Программа, работающая в 200-человечной US-tech компании, может не подходить 40-человечному казахстанскому fintech с другими демографическими категориями и другими юридическими рамками. Локализуйте раньше, чем копируете фреймворки.

Самый жёсткий тезис

DEI-программа, меряющая только найм, — программа первого года. Большинство компаний гоняет программы первого года вечно. Команды, реально меняющие представленность на сеньорных уровнях, — те, кто вышел за рамки найма в retention, промоушены и назначения, с тем же rigor, что применяют к DORA. Инженерные лидеры, читающие DORA-отчёт, но не читающие отчёт по скорости промоушенов, ведут только половину своей организации.

По теме

- Метрики без токсичности — как измерять, не создавая surveillance-культуру

- 10 инженерных метрик, которые надо трекать — базовый набор

- On-Premise Docker/K8s Deployment — для регулируемых HR-данных

- Внешнее: McKinsey: Women in the Workplace 2024 — данные по «сломанной ступеньке»

- Внешнее: GitHub Octoverse 2024 — open-source review паттерны