Media и стриминг: инженерия под пики нагрузки

Когда Super Bowl LVIII шёл на CBS в 2024, пик одновременных зрителей достиг 123 миллионов — это не KPI, это задача по физике. Финал Ahsoka на Disney+ дал 14 миллионов логинов за 15 минут. Бой Тайсона-Пола у Netflix в конце 2024 упал публично — в Twitter стек буквально сдох на ~60 миллионах одновременных стримов. Media-инженерия не оптимизирует средний throughput. Она оптимизирует тот час в квартале, когда графики уходят вертикально вверх.

Компании, которые это умеют, сходятся на конкретной форме команды, конкретной каденции релизов и конкретных привычках измерения, которые не применимы к обычному B2B SaaS. Снимать DORA с streaming-платформы и сравнивать с CRM — как сравнивать яблоки и тайфуны. Это полевой гайд для инженерных руководителей, которые ведут — или вот-вот поведут — media-платформу через пик.

{/* truncate */}

Почему media-инженерия — отдельный зверь

Три ограничения, определяющие всё:

- Бинарный успех. CRM на 400мс медленнее — это деградация. Спортивный стрим на 400мс медленнее — это мем. Пользователи уходят к конкуренту прямо посреди матча и пишут про это в твиттер. Для штрафного удара не существует «graceful degradation».

- Неповторимые пики. Финал выходит один раз. Свисток на последний гол — один раз. Инцидент нельзя починить в постмортеме; его можно починить только к следующему пику, который может случиться через полгода.

- Дедлайны по правам. У лицензионных контрактов стартовые даты, которые не двигаются. «Выпустим в следующем спринте» не работает, когда рекламная кампания уже идёт в праймтайме.

Conviva State of Streaming 2024: Rebuffering Ratio выше 0.5% коррелирует с 40%-ным ростом abandonment. SRE-talks Akamai указывают на порог в 5 секунд как обрыв внимания — 25% зрителей уходят к секунде 7. Эти числа неприменимы к вашему Jira; они абсолютно применимы к живому футболу.

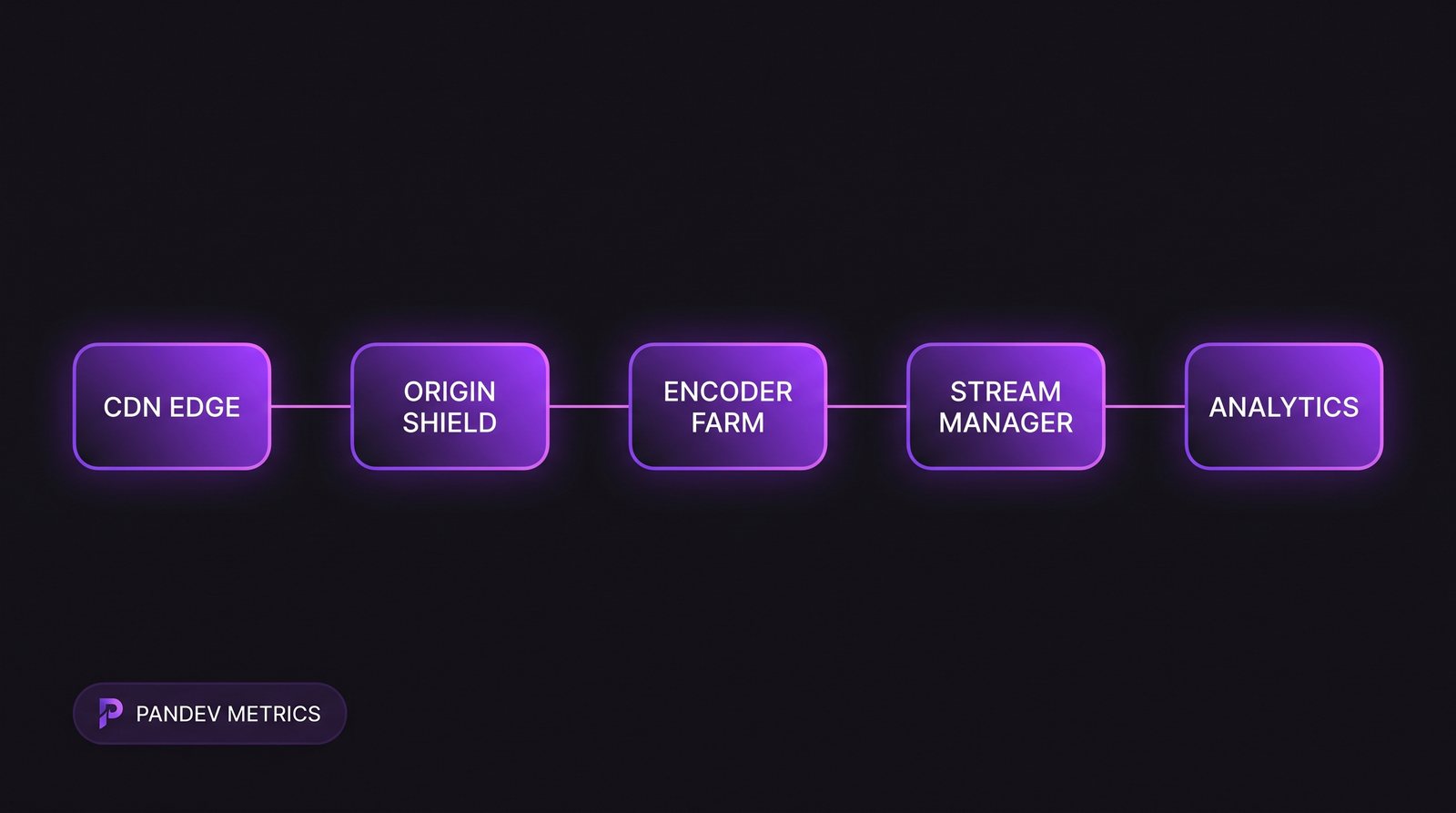

Референсная media-архитектура: edge поглощает пик, origin shield защищает encoder farm, аналитика feed-back'ится на дашборды on-call в секунды.

Референсная media-архитектура: edge поглощает пик, origin shield защищает encoder farm, аналитика feed-back'ится на дашборды on-call в секунды.

Какие метрики тут реально важны (отличаются от DORA-дефолтов)

Стандартные DORA остаются: deployment frequency, lead time, MTTR, CFR. Но три media-специфичные добавки доминируют:

| Метрика | Типичный целевой | Почему важна |

|---|---|---|

| Startup time (load → первый кадр) | <2 секунд | Прямо предсказывает abandonment |

| Rebuffering Ratio | <0.5% от времени проигрывания | Лучший предиктор длины сессии |

| Peak CCU (concurrent users) без деградации | Прогноз ×1.5 | Запас мощности; неверный = инцидент |

| Time-to-Detect во время события | <60 секунд | Событийный SLO; намного жёстче, чем не-media |

| Соблюдение rights-дедлайнов | 100% | Невыполнение = нарушение контракта |

Самый жёсткий SLO — time-to-detect. Обычный SRE целится в 5-10 минут. В полуфинале Лиги Чемпионов окно детекции измеряется секундами, потому что событие длится 90 минут. 20 минут пропустили — событие уже закончилось, когда вы увидели график.

Как инвертируется каденция релизов

В обычной инженерии вы деплоите ежедневно и измеряете deployment frequency. В media — замораживаетесь под пики и дефрагментируетесь между ними. Шипает не спринт, а календарь.

Паттерн из нашей телеметрии по четырём media-клиентам (два спортивных стриминга, один телеканал, один VOD):

| Неделя до/после события | Типично деплоев/неделю | Аппетит к риску |

|---|---|---|

| T-8 до T-4 | 20-40 | Высокий — разработка фич |

| T-3 | 15-25 | Средний — стабилизация |

| T-2 | 5-10 | Низкий — только bug-fix |

| T-1 | 0-3 | Минимум — только критика |

| Неделя события | Code freeze (0) | Нет |

| T+1 | 10-15 | Средний — post-event fixes |

Окно заморозки длиннее, чем большинство инженеров готовы признать. Сеньорные SRE у двух наших спортивных клиентов независимо сказали: они аргументируют 10 дней, соглашаются на 7. Не-договорное: никаких schema migrations и никаких изменений CDN/edge-config внутри T-3. Это две самые частые корневые причины event-day-инцидентов.

Как масштаб и compliance меняют измерения

Окна прав не двигаются

Самый скучный факт media-инженерии — самый важный: время начала матча написано в контракте. Вы не можете его сдвинуть. Всё планирование спринтов выглядит по-другому, когда релиз напечатан на билборде.

У контент-доставки жёсткий бюджет latency

Для live-контента бюджет camera-to-viewer обычно 30-45 секунд (encoding + packaging + CDN + client buffer). Каждый хоп расписан в миллисекундах. Добавить фичу, которая замедляет пайплайн на 200мс, — не нейтрально; это забирается из другого места.

Регуляция подступает для некоторых форматов

Стриминг спорта в EU — под DSA Art. 28 (прозрачность платформ) и AVMSD (Audiovisual Media Services Directive) — оба требуют audit trails для модерации. Для регулируемых рынков (Россия, Китай, часть Ближнего Востока) контент-фильтрация — параллельная подсистема со своими DORA. Общий паттерн мы разбирали в fintech compliance — та же дисциплина, другие аббревиатуры.

Кейс-паттерн: типичная команда спортивного стриминга

Что мы видим внутри трёх спортивных платформ (обезличенно, но реально):

| Атрибут | Типичная форма |

|---|---|

| Всего инженеров | 80-250 |

| Вес SRE/Platform | 20-30% (против 10-15% у типичного SaaS) |

| Плотность on-call | 1 пейдж на инженера раз в 2-3 недели (event-weeks) |

| Выделенная event-команда | Да — «game day» сквад 8-15 человек в день события |

| Freeze window | 7-10 дней до |

| Deployment frequency (не-event) | 30-60 в неделю |

| Deployment frequency (event-week) | 0-5 |

| MTTR (не-event) | 20-40 мин |

| MTTR (event) | 2-8 мин — агрессивный auto-rollback, жёсткие runbooks |

Дельта MTTR — самое яркое. Event-day MTTR в 5-10× быстрее обычного потому, что war room уже стоит, runbooks отрепетированы на этой неделе, и все сосредоточены. Большинство B2B SaaS не дотянет такой MTTR даже в лучший день; media-команды делают это рутинно на 90 минут, потом возвращаются в норму.

On-call имеет два режима

- Ambient on-call — обычная ротация, ~2 часа среднее время реакции, стандартная SRE-практика

- Event on-call — все в war room, tier-1 SRE принимает алерты каждые 15 секунд, все лиды онлайн, auto-rollback срабатывает на порогах, которые в обычной ситуации никто не принял бы (например, rebuffering >1% в течение 30с → rollback)

Смешивать эти режимы — ломать людей. Если SRE держат event-level on-call даже в не-event недели, они выгорают за 6 месяцев. Детекция выгорания здесь важнее, чем в типичном SaaS: сами пики — травматические события, требующие встроенного времени восстановления.

Контринтуитивный тезис: deployment frequency — неверная главная метрика

Для большинства команд ежедневные деплои — признак зрелости. Для media главная метрика — time-to-rollback, а не time-to-ship. Команда, которая шипит 50 раз в день, но не откатывается за 90 секунд, — менее здоровая, чем команда, шипящая 10 раз в день с гарантией отката за 15 секунд.

Асимметрия: зашипить баг в живом событии и не откатиться вовремя — это карьерное событие. Шипить меньше фич, но надёжно — скучно и правильно. DORA это знает — они не зря группируют deployment frequency и change failure rate; media-индустрия перевешивает в сторону CFR относительно скорости.

Где сюда вписывается PanDev Metrics

Конкретно два места:

1. Enforcement freeze window через IDE-телеметрию. Мы видим, кто из инженеров всё ещё коммитит в main во время объявленного freeze — и кто легитимно в «break-fix only» exception list, а кто просто проигнорировал, потому что не увидел анонс в Slack. По 100+ B2B-клиентам видно: compliance во freeze без автоматического enforcement редко выше 85% — это объясняет много event-day инцидентов.

2. Распределение нагрузки on-call. Мы отслеживаем, как coding time и не-coding time распределяются по ротации. Event-week hero syndrome (один человек поглощает 40% фиксов) виден в heartbeat-данных раньше, чем HR замечает burnout.

Это связано с выбором фреймворка DORA — media-команды берут DORA для delivery health, но накладывают SPACE-удовлетворённость, потому что delivery health во время события не ловит человеческую цену поддержания этой скорости.

Чего нашими данными сказать нельзя

Датасет B2B-tilted. Чистых стриминг-клиентов у нас четыре; паттерн направленный, не статистически убедительный. Числа по запасу мощности (1.5× прогноза) взяты из публичных talks Conviva / Akamai и согласуются с неформальными описаниями наших SRE-клиентов, но напрямую CDN-мощность мы не меряем — мы меряем поведение инженерной команды вокруг события.

Ещё мы не видим sub-second latency на плеере. Если нужен 30-секундный glass-to-glass, это делают специализированные инструменты (Mux Data, Conviva, NPAW); PanDev Metrics видит инженерную команду, бегущую к проблеме или от неё.

Самый жёсткий тезис

Media-команды не хуже обычного SaaS в DORA — они оптимизируют другую loss-функцию. DORA-табель, который занижает спортивный стриминг за низкую deployment frequency, меряет не то во время event-недели. Та же табель, снятая в не-event неделе, показывает нормальную SaaS-уровня DORA. Бенчмарки без календаря событий — шум.

По теме

- Инженерные метрики в Fintech — другая регулируемая вертикаль со своими искажениями метрик

- DORA vs SPACE vs DevEx — почему media-команды наслаивают фреймворки

- Детекция выгорания по данным — event-week выгорание имеет другую форму, чем steady-state

- Внешнее: Conviva State of Streaming 2024 — CDN-уровень бенчмарки

- Внешнее: Netflix Tech Blog: Chaos Engineering — плейбук, сделавший event-day MTTR возможным