Performance review на основе данных: шаблоны и антипаттерны

Анализ Harvard Business Review показал, что более 90% менеджеров признают: процесс performance review в их компании не даёт точных результатов. В инженерии проблема ещё хуже: менеджеры пишут размытые абзацы на основе того, что помнят за последние две недели. Тихие высокоэффективные сотрудники остаются незамеченными. Громкие слабые — получают оценки выше заслуженного. И все уходят с ощущением, что процесс был произвольным. Данные это исправляют — но только если использовать их правильно.

{/* truncate */}

Проблема традиционных инженерных ревью

Назовём предвзятости, которые отравляют большинство циклов ревью:

| Предвзятость | Что происходит | Пример |

|---|---|---|

| Эффект недавности | Оценивается только последняя работа | Разработчик, выпустивший крупную фичу в Q1, но с медленным Q3, получает «нужно улучшение» |

| Эффект доступности | Видимая работа считается больше | Разработчик, который презентует на all-hands, получает оценку выше того, кто тихо чинит критическую инфраструктуру |

| Эффект ореола | Одна черта окрашивает всё | «Она отличный коммуникатор» превращается в «она отлична во всём» |

| Предвзятость схожести | Похожие на менеджера получают выше | Экстраверты получают лучшие ревью от экстравертных менеджеров |

| Якорение | Оценка прошлого года сохраняется | «Он был 3 в прошлом году, значит, он, наверное, и сейчас 3» |

Данные не устраняют предвзятость — люди всё ещё интерпретируют данные — но создают объективный фундамент, который гораздо сложнее игнорировать или искажать. Это согласуется с исследованиями программы Accelerate (Forsgren, Humble, Kim), которые показали, что практики управления на основе данных коррелируют как с более высокой производительностью команд, так и с более сильной организационной культурой.

Какие данные собирать для ревью

Хорошее инженерное ревью должно опираться на несколько источников. Ни одна метрика не рассказывает всю историю.

Количественные данные (из инженерной платформы)

| Точка данных | Период | Назначение |

|---|---|---|

| Тренд Activity Time | Весь период ревью | Бейзлайн рабочих паттернов |

| Средний Focus Time | Весь период ревью | Способность к глубокой работе и качество среды |

| Delivery Index | Весь период ревью | Стабильность доставки относительно обязательств |

| Время цикла PR | Весь период ревью | Эффективность рабочего процесса |

| Участие в code review | Весь период ревью | Вклад в команду помимо своего кода |

| Распределение по проектам | Весь период ревью | Объём и сложность работы |

| Стоимость по проекту | Весь период ревью | Контекст бизнес-влияния |

Качественные данные (от людей)

| Источник | Метод | Назначение |

|---|---|---|

| Обратная связь коллег | 360-опрос или прямые разговоры | Коллаборация, менторство, влияние |

| Самооценка | Письменная рефлексия | Собственная перспектива разработчика |

| Обратная связь PM/дизайна | Кросс-функциональный ввод | Коммуникация, надёжность, партнёрство |

| Влияние на клиента | Отчёты об инцидентах, принятие фич | Бизнес-результаты |

| Наблюдения менеджера | Записи 1:1 за период | Рост, вызовы, контекст |

Формула проста: количественные данные показывают, что произошло; качественные — почему это важно.

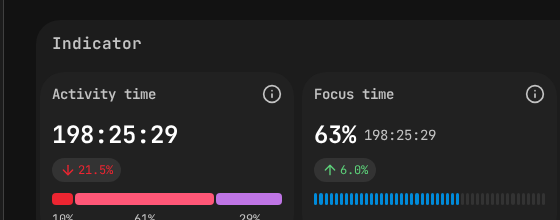

Вид сотрудника в PanDev Metrics — Activity Time (198ч) и Focus Time (63%) дают объективные точки данных для справедливой оценки.

Вид сотрудника в PanDev Metrics — Activity Time (198ч) и Focus Time (63%) дают объективные точки данных для справедливой оценки.

Шаблон performance review на основе данных

Полный шаблон для написания инженерного performance review, подкреплённого данными.

Раздел 1: Сводка и оценка

Разработчик: [Имя]

Роль: [Текущая должность]

Период ревью: [Q1-Q2 2026 / Год 2025-2026]

Менеджер: [Ваше имя]

Общая оценка: [Превосходит / Соответствует / Ниже ожиданий]

Резюме в одном абзаце:

[2-3 предложения, фиксирующих общую эффективность,

ключевые достижения и траекторию роста. Должно быть

подкреплено данными ниже.]

Раздел 2: Доставка и влияние

Ключевые метрики (период ревью):

- Delivery Index: [X] (среднее по команде: [Y])

- Завершённые проекты: [список]

- Оценочное бизнес-влияние: [выручка, экономия, снижение рисков]

Ключевые достижения:

- [Конкретное достижение #1 с данными]

- [Конкретное достижение #2 с данными]

- [Конкретное достижение #3 с данными]

Пример:

«Возглавил миграцию процессинга платежей (Проект Falcon) с

устаревшей системы на Stripe. Delivery Index 0.92 по проекту

при среднем по команде 0.78. Миграция снизила затраты на

обработку платежей на 34% ($180K годовой экономии) и

сократила ошибки оплаты на 60%.»

Раздел 3: Технический рост

Ключевые метрики:

- Тренд времени цикла PR: [улучшается / стабильно / снижается]

- Качество code review: [сводка обратной связи коллег]

- Технический охват: [типы проектов и сложность]

Оценка:

- [Техническая область #1]: [Оценка на основе доказательств]

- [Техническая область #2]: [Оценка на основе доказательств]

- [Архитектура/дизайн-вклад]: [Конкретные примеры]

Пример:

«Время цикла PR улучшилось с 8 часов до 3.5 часов в среднем

за период ревью, что отражает лучший размер PR и более чёткие

описания. Обратная связь коллег постоянно отмечает тщательные,

конструктивные code review — 156 PR отревьюено в 4 командах.»

Раздел 4: Коллаборация и лидерство

Ключевые метрики:

- Кросс-командная активность ревью: [X ревью вне своей команды]

- Менторство: [доказательства из 1:1, обратная связь коллег]

- Передача знаний: [документация, техтоки, парное программирование]

Оценка:

[Нарратив на основе обратной связи коллег и наблюдаемого поведения]

Пример:

«Наставлял двух джуниор-разработчиков в ходе онбординга.

Оба вышли на самостоятельный вклад за 6 недель

(среднее по команде: 10 недель). Обратная связь коллег

отмечает терпение и чёткость в комментариях к code review.»

Раздел 5: Области для роста

На основе данных и обратной связи, фокусные области на следующий период:

1. [Область #1]: [Конкретное наблюдение на основе доказательств]

План действий: [Конкретные шаги]

2. [Область #2]: [Конкретное наблюдение на основе доказательств]

План действий: [Конкретные шаги]

Пример:

«Focus Time составлял в среднем 1.2 часа/день vs среднего по команде

2.8 часов. Расследование показывает высокую нагрузку совещаниями

(12 регулярных встреч/неделю) и частое переключение между 4

параллельными проектами. План действий: сократить регулярные

встречи до 6, ограничить параллельные проекты до 2, ввести

среду как день без совещаний для глубокой работы.»

Раздел 6: Цели на следующий период

Цель 1: [SMART-цель, привязанная к области роста]

Измеряется: [Конкретная метрика или веха]

Цель 2: [SMART-цель, привязанная к карьерному росту]

Измеряется: [Конкретная метрика или веха]

Цель 3: [SMART-цель, привязанная к влиянию на команду/организацию]

Измеряется: [Конкретная метрика или веха]

Процесс калибровки

Написание индивидуальных ревью — только половина дела. Калибровка — процесс обеспечения согласованности между менеджерами и командами — вот где данные становятся незаменимы.

Пакет данных для калибровки

Перед встречей по калибровке каждый менеджер должен подготовить:

| Элемент | Детали |

|---|---|

| Распределение оценок | Предложенные оценки для команды |

| Сводка метрик | Ключевые метрики каждого участника (при необходимости анонимно) |

| Обоснование выбросов | Для всех с оценкой «Превосходит» или «Ниже» — конкретные данные |

| Кросс-командное сравнение | Как метрики команды соотносятся со средними по организации |

Фреймворк встречи по калибровке

Шаг 1: Представление распределений (15 мин) Каждый менеджер представляет распределение оценок. Ищем статистические красные флаги:

- Один менеджер всем ставит «Превосходит»? (Смягчающая предвзятость)

- У другого менеджера вся команда «Соответствует»? (Тенденция к центру)

- Распределения примерно соответствуют ожидаемым паттернам?

Шаг 2: Ревью выбросов (30 мин) Фокус на оценках «Превосходит ожидания» и «Ниже ожиданий». Для каждой:

- Менеджер представляет обоснование данными

- Другие менеджеры задают вопросы

- Группа решает, откалиброван ли рейтинг

Шаг 3: Кросс-командная согласованность (15 мин) Сравниваем разработчиков с одинаковыми оценками из разных команд:

- «Соответствует» в Команде A выглядит так же, как «Соответствует» в Команде B?

- Согласованы ли планка и ожидания?

Шаг 4: Финализация (10 мин) Фиксируем оценки, отмечаем действия для follow-up.

Калибровочная таблица

Используйте эту таблицу для быстрого выявления несогласованностей:

| Разработчик | Delivery Index | Focus Time | Время цикла PR | Оценка коллег | Предложенный рейтинг |

|---|---|---|---|---|---|

| Разр. A | 0.91 | 3.1 ч | 3.2 ч | 4.5/5 | Превосходит |

| Разр. B | 0.85 | 2.8 ч | 4.1 ч | 4.2/5 | Соответствует |

| Разр. C | 0.88 | 2.9 ч | 3.0 ч | 4.4/5 | Соответствует |

| Разр. D | 0.62 | 1.1 ч | 12.3 ч | 3.1/5 | Ниже |

В этом примере данные Разр. C сопоставимы с Разр. A — группа калибровки должна спросить, почему рейтинги различаются. Может быть валидная качественная причина. А может — предвзятость.

Антипаттерны, разрушающие доверие

Антипаттерн 1: Ревью только по метрикам

Как выглядит: «Ваш Activity Time составил 2.1 часа/день. Среднее по команде — 2.8. Оценка: Ниже ожиданий.»

Почему не работает: Без контекста. Разработчик мог заниматься архитектурной работой, менторить джуниоров, разбирать инциденты или справляться с личной ситуацией. Метрики без нарратива — это обвинения.

Исправление: Каждая приведённая метрика должна сопровождаться вопросом или разговором. Если вы не обсуждали это на 1:1 — ей не место в ревью.

Антипаттерн 2: Ревью-сюрприз

Как выглядит: Разработчик впервые узнаёт о проблемах с продуктивностью на ревью.

Почему не работает: Слишком поздно корректировать курс. Разработчик чувствует себя в ловушке, и доверие разрушено навсегда.

Исправление: Если данные показывают тревожный тренд, обсудите его на 1:1 сразу. К моменту ревью не должно быть ни одного сюрприза.

Антипаттерн 3: Принудительное распределение

Как выглядит: Навязывание нормального распределения. «Нужно ровно 10% Превосходит, 70% Соответствует, 20% Ниже.»

Почему не работает: Если вы хорошо нанимали, большинство должно соответствовать ожиданиям. Принудительная кривая означает, что вы врёте о чьей-то эффективности — завышаете или занижаете — чтобы попасть в квоту.

Исправление: Оценивайте относительно ожиданий к роли, а не друг относительно друга. Используйте калибровку для согласованности, а не для принудительного распределения.

Антипаттерн 4: Копипаст

Как выглядит: «Продолжает быть сильным контрибьютором. Соответствует ожиданиям по всем областям.» — идентично прошлому кварталу.

Почему не работает: Говорит разработчику, что вы не обращали внимания. Не даёт направления для роста. Демотивирует.

Исправление: Ссылайтесь на конкретные данные за период ревью. Называйте проекты, изменения метрик и конкретные примеры. Если не можете — вы недостаточно наблюдали за период.

Антипаттерн 5: Двигающаяся планка

Как выглядит: «Ты выпустил всё, что мы просили, но мы ожидали, что ты ещё возьмёшь больше лидерства.»

Почему не работает: Нельзя оценивать по критериям, о которых не сообщали.

Исправление: Установите явные ожидания в начале каждого периода. Запишите их. Проверьте в середине периода. Оценивайте только по ним — и ни по чему другому.

Разговор при вручении ревью

Хорошие данные и хорошо написанное ревью необходимы, но недостаточны. То, как вы его вручаете, имеет огромное значение.

До встречи

- Отправьте форму самооценки минимум за неделю до ревью

- Внимательно прочитайте самооценку перед написанием финального ревью

- Подготовьтесь к несогласиям — знайте, какие данные поддерживают вашу оценку

Во время встречи

- Начните с их самооценки (5 мин): «Как ты оцениваешь свою работу за этот период?»

- Назовите общую оценку (2 мин): не затягивайте. Скажите оценку рано.

- Пройдитесь по доказательствам (15 мин): раздел за разделом, со ссылками на данные

- Обсудите области роста (10 мин): подайте как инвестицию, а не критику

- Поставьте цели вместе (10 мин): совместно, а не директивно

- Вопросы (оставшееся время): дайте задать любые

После встречи

- Отправьте письменный документ ревью в течение 24 часов

- Назначьте follow-up 1:1 в течение недели (у них будут вопросы после переваривания)

- Отслеживайте прогресс по целям роста на регулярных 1:1

Построение культуры готовности к ревью

Если вы хотите, чтобы ревью на основе данных работали, нужно построить инфраструктуру до сезона ревью:

Постоянно (не только в период ревью):

- Отслеживайте инженерные метрики непрерывно — не пытайтесь восстановить данные за 6 месяцев ретроспективно

- Используйте 1:1 для регулярного обсуждения данных, чтобы это стало нормой, а не сюрпризом

- Собирайте обратную связь коллег на протяжении всего цикла, а не в последнюю минуту

Таймлайн подготовки к циклу:

| Когда | Действие |

|---|---|

| Начало периода | Установить ожидания и измеримые цели с каждым |

| Ежемесячно | Быстрая проверка данных по каждому; корректировка на 1:1 |

| Середина цикла | Формальный чекин с обзором данных |

| За 2 недели до ревью | Выгрузить метрики за весь период; собрать обратную связь коллег |

| За 1 неделю | Разослать формы самооценки |

| Неделя ревью | Написать ревью; провести калибровку; вручить |

| 1 неделя после | Follow-up разговоры; поставить цели на следующий период |

Справедливое ревью начинается со справедливых данных

Весь фреймворк выше основан на одном допущении: ваши данные полны и справедливы. Это значит:

- Измерять результаты, а не только выходы — влияние доставки, а не строчки кода

- Учитывать невидимую работу — code review, менторство, реагирование на инциденты, документация

- Признавать различия ролей — метрики staff-инженера будут отличаться от джуниора

- Прозрачность — разработчики должны видеть те же данные, по которым вы их оцениваете

Последний пункт критичен. Когда разработчики имеют доступ к собственным дашбордам и могут отслеживать свои метрики, ревью превращается в разговор двух людей, смотрящих на одни и те же данные — а не в приговор сверху. Как аргументирует Will Larson в An Elegant Puzzle, лучшие системы ревью — те, где результат известен обеим сторонам ещё до встречи, потому что данные были открыты и обсуждались на протяжении всего периода.

Постройте процесс ревью, которому ваши инженеры действительно доверяют. PanDev Metrics предоставляет дашборды на каждого разработчика с Activity Time, Focus Time, Delivery Index и аналитикой затрат — видимые и менеджерам, и разработчикам. Экспорт в Excel или PDF для документации ревью. Начните собирать данные сейчас, чтобы следующий цикл ревью был подкреплён доказательствами, а не памятью.