Travel-инженерия: команды букинг-платформ

Бывший инженер Expedia сказал фразу, которую стоит повесить над столом любой travel-команды: «Мы не релизим софт — мы релизим обещания о будущей доступности физических объектов». Запрос к Amadeus GDS возвращает инвентарь, который одновременно разбирают 50+ конкурирующих distribution-каналов. Ваш код должен это свести меньше чем за 400ms, иначе пользователь уходит.

Отчёт Phocuswright 2024 оценивает глобальную индустрию онлайн-тревела в $1.06 трлн gross bookings, из которых ~38% проходит через технологические платформы между путешественником и поставщиком. Аналитика travel-вертикали AWS фиксирует: пиковый трафик на букинг-движках регулярно превышает годовой baseline в 15 раз — более экстремальная асимметрия, чем у любой другой e-commerce вертикали кроме Black Friday retail. Команды, построенные на предпосылке «просто масштабируемся горизонтально», в первый декабрь обнаруживают, что промахи поискового кеша при недоступности GDS генерируют каскадные отказы на 90 секунд в глубину.

{/* truncate */}

Чем travel-инженерия отличается

Снаружи travel-платформы выглядят как обычные букинг-маркетплейсы. Инженерная дивергенция начинается в трёх местах:

Legacy distribution-протоколы. Три главных GDS — Amadeus, Sabre, Travelport — до сих пор питают доступность большинства авиа, отелей и аренды авто. Они работают на протоколах 1960-80-х (Type B messaging, EDIFACT, и более новый NDC XML). Greenfield-команда, ожидающая REST+JSON везде, первые два года будет писать адаптеры. NDC (New Distribution Capability) — стандарт IATA, призванный модернизировать это; на 2026 год он внедрён частично — Lufthansa Group гонит ~70% indirect revenue через NDC, большинство американских перевозчиков всё ещё ниже 20%.

Timezone-математика как first-class concern. Рейс вылетает из JFK в 22:00 по местному времени 2026-07-15, прибывает в LHR в 10:00 по местному 2026-07-16. Это 11-часовой рейс или 7-часовой? Зависит от DST, маппинга трёхбуквенных IATA-кодов аэропортов к часовым зонам и того, хранит ли ваш PNR (Passenger Name Record) UTC, локальное время или оба. Каждый инженер, приходящий в travel-платформу, на второй неделе переписывает что-то, что в кодовой базе было неправильно.

Объём отмен и изменений. SaaS-транзакция обычно финальна. Booking-транзакция модифицируется — в среднем 30-40% бронирований имеют хотя бы одно пост-букинг изменение (смена расписания, смена пассажира, отмена, возврат, re-shop). Инженерная поверхность — не «забронировать рейс», а «забронировать рейс, потом независимо изменить каждое поле, потом частично вернуть деньги, потом забронировать связанную ancillary-услугу».

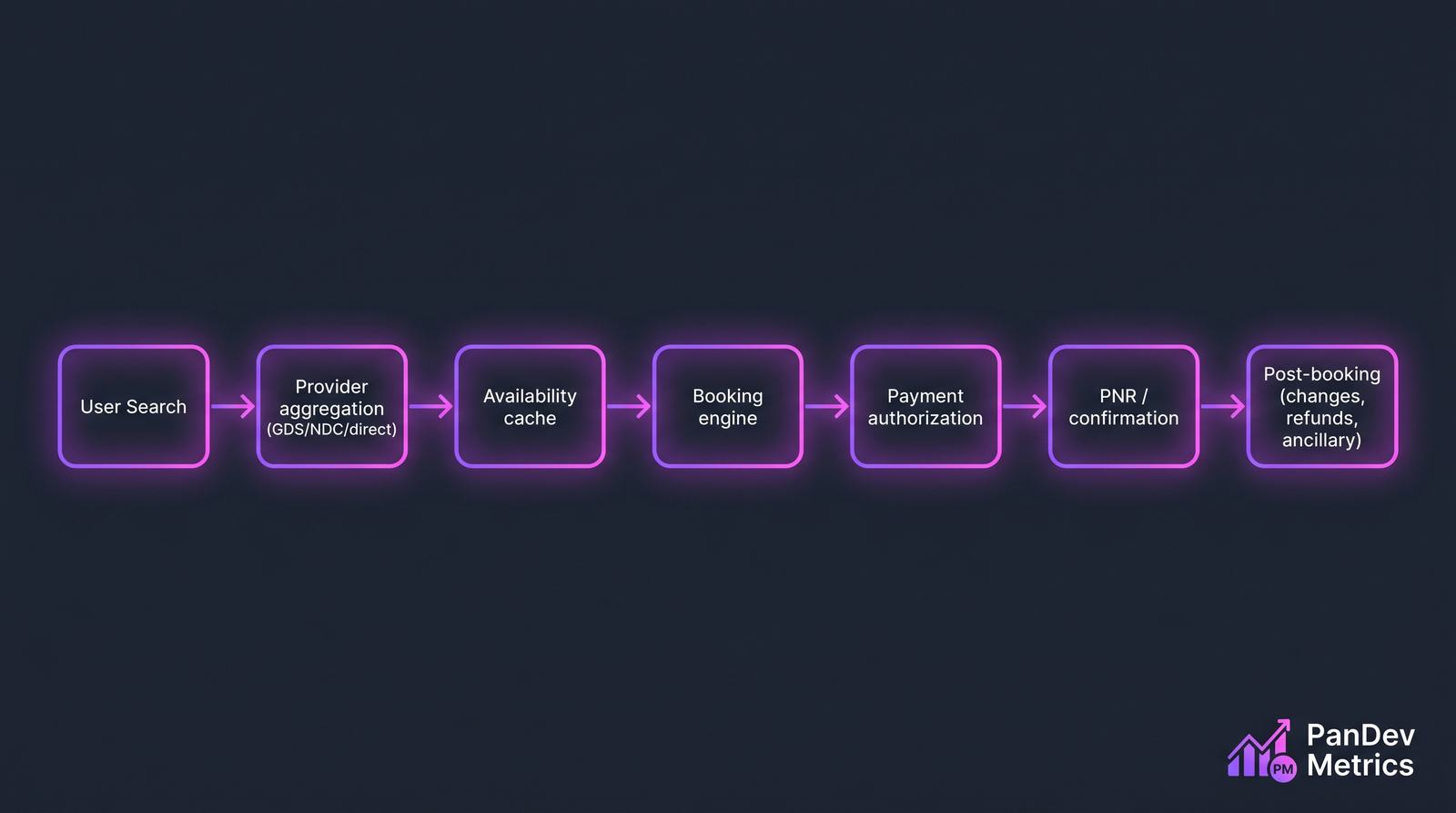

"Happy path" из 7 стадий. У каждой свои failure modes, таймауты и требования к компенсирующим транзакциям.

"Happy path" из 7 стадий. У каждой свои failure modes, таймауты и требования к компенсирующим транзакциям.

5 метрик, которые важны

1. Look-to-book ratio (с сегментацией по search response time)

Обычный e-commerce меряет конверсию. Travel-инженерия меряет look-to-book — отношение уникальных поисковых сессий к завершённым бронированиям — сегментированный по бакетам search response time. Быстрый сайт с тем же booking rate, что и медленный — тратит кеш-бюджет впустую. Медленный сайт с более низким booking rate требует latency-инвестиций.

| P95 поиска | Типичный look-to-book для OTA | Что значит |

|---|---|---|

| < 500ms | 3.5-5.5% | Здорово; кеш-слой окупает стоимость |

| 500ms-1s | 2.5-3.5% | Граница; смотрите tail latency |

| 1-2s | 1.5-2.5% | Недобор; drop-off выше бенчмарка отрасли |

| > 2s | < 1.5% | Вы теряете деньги, гоня юзеров с рекламы на медленную страницу |

В SEC-отчётах Trivago до реструктуризации 2023 года look-to-book был top-line метрикой. Когда он упал ниже 2%, бизнес был структурно сломан ещё до провала Q3.

2. Надёжность PNR (метрика commit-success)

PNR — это запись, привязывающая путешественника к зарезервированному маршруту. Его создание требует скоординированных commit'ов через вашу платформу, GDS и (часто) авторизацию платежа. Может упасть в любой точке — и частичные отказы это hard case (списали деньги, но GDS отверг seat map).

Инженерная метрика: какой процент попыток бронирования завершается подтверждённым PNR с согласованным downstream-состоянием (списанная сумма = цене маршрута, email-подтверждение отправлено, mobile-приложение обновлено)?

| Тип платформы | Хороший PNR-reliability | Red flag |

|---|---|---|

| Direct-connect (airline.com) | > 99.5% | < 99% |

| NDC-aggregator | > 99% | < 98% |

| Traditional GDS aggregator | > 98.5% | < 97% |

| Meta-search (redirect-only) | N/A | Не применимо — redirect снимает конверсию |

Failure-кейсы дают самый большой объём саппорт-тикетов в travel. Команды, инвестирующие в saga-паттерны / компенсирующие транзакции вокруг создания PNR, видят падение объёма тикетов на 40-60% в следующий квартал.

3. Дисциплина peak-season deploy freeze

Трафик неоднороден. Зимний peak (ноябрь — середина января outbound-leisure), летний peak (май-август inbound-European leisure), локальные праздники (китайский новый год, российские майские, Golden Week) дают спайки 8-15× baseline. Инженерная практика — code-freeze в эти окна на booking-path сервисах.

| Класс сервиса | Длина freeze | Что разрешено |

|---|---|---|

| Booking engine + PNR | 6-8 недель | Только rollback-safe хотфиксы с change-review |

| Search / inventory | 4-6 недель | Feature-flagged изменения, off by default |

| Payment integration | 8-10 недель | Только security-патчи |

| Post-booking (changes, refunds) | 3-4 недели | Полные деплои; масштабирование ёмкости |

| Marketing / content | Без freeze | Ежедневные деплои ожидаются |

Команды, пропускающие эту дисциплину, получают on-call ротации, которые сгорают к середине сезона. DORA-метрика deploy frequency читается зелёной, пока команда структурно нездорова; наш пост про deployment frequency аргументирует за cadence, но travel — та отрасль, где безразличный cadence активно вредит.

4. Lead time: отмена → возврат

Большинство travel-платформ недоинструментируют post-booking операции, потому что дашборд по умолчанию смотрит pre-booking воронку. Таймлайн возврата — инженерная метрика, которую клиенты абсолютно замечают:

| Стадия возврата | Типичная длительность | Что блокирует |

|---|---|---|

| Запрос отмены → отмена в GDS | < 2мин | Retry-логика против сбоев GDS |

| Подтверждение GDS → запрос возврата провайдеру | < 10мин | Надёжность API провайдера |

| Возврат провайдера → расчёт acquirer | 2-5 рабочих дней | Батч-расписание платёжного процессора |

| Acquirer → банк клиента | 3-10 рабочих дней | Обработка банком (вне нашего контроля) |

Инженерно контролируется часть 1-3. Команды, инструментирующие каждую стадию отдельно и задающие per-stage SLA, релизят более быстрые refund-флоу и, измеримо, удерживают клиентов на rebook выше.

5. Rate разрешения concurrent-модификаций

Когда у отеля последний свободный номер, и двое пользователей пытаются забронировать одновременно, номер получит ровно один — но UI второго пользователя 200ms назад показывал доступность. Система должна детектировать гонку, чисто вернуть деньги если списание произошло, и показать связный путь ошибки.

Метрика: из всех попыток бронирования, упавших из-за concurrent-modification / sold-out-during-checkout, какой процент разрешается без создания саппорт-тикета? Хорошие travel-платформы сидят на 85-95%. Платформы под 70% имеют структурные проблемы с обработкой race-conditions; платформы около 100% вероятно вообще не детектируют гонку (хуже — тихий отказ).

Как масштаб и compliance меняют измерение

PCI-DSS везде. Каждая travel-платформа обрабатывает данные карт. Scope reduction через токенизацию — главная инженерная инвестиция; сервисы, видящие raw PAN, должны быть счётным списком, не дефолтом. Travel-дашборды должны трекать площадь PCI-scope: количество сервисов / репозиториев / инженеров с доступом к in-scope payment data. Это число должно тренд-даун, не тренд-ап.

ЕС / GDPR + локальная резидентность данных. Номера паспортов, национальность, номера программ лояльности — special-category data в большинстве юрисдикций. Компании в Казахстане, России, Китае, Бразилии или Вьетнаме сталкиваются с требованиями локализации, которые делают multi-tenant SaaS-платформы метрик non-starter. On-prem становится дефолтом, не исключением, для B2B travel-tech работающего через эти рынки.

Дисциплина supplier rate-limit. GDS и NDC API берут деньги за запрос и жёстко throttle. Плохо настроенный кеш стоит семизначных чисел в год в избыточных query fees. Инженерные метрики типа «queries per successful booking» ловят это раньше любого финансового дашборда — типичный здоровый ratio 30-80 поисковых запросов на завершённое бронирование; выше 200 значит кеш не работает.

Типовой профиль travel-платформы

| Параметр | Типичный диапазон (2026) |

|---|---|

| Размер команды | 80-500 инженеров для mid-size OTA, 2,000+ для глобальных агрегаторов |

| Стек | Java/Kotlin booking core, Go или Node edge-сервисы, React web, Swift/Kotlin mobile |

| Deploy cadence | Ежедневно в off-season, еженедельно в freeze-окнах |

| Основное давление | Search latency + PNR reliability + timezone/DST корректность |

| Интеграции | Amadeus, Sabre, Travelport (GDS), NDC-aware aggregators, 50-200 прямых hotel connections, 5-15 платёжных провайдеров |

| Чувствительность данных | PCI + PII (паспорт, DOB, FF-номера) — scope-reduced, но неизбежно |

| Пик/трог | 8-15× год, 3-5× день |

Контрарианское утверждение

Travel-лидеры зациклены на latency букинг-пути. Метрика, которая реально компаундирует годами, — время отмена → возврат. Путешественник с отменённым рейсом, которому вернули за 48 часов, рассказывает друзьям; путешественник, которому возвращали 6 недель, помнит это десятилетие. Инженерные инвестиции в пост-букинг операции дают улучшения retention, проявляющиеся в LTV-моделях через 18-24 месяца — далеко за окном терпения большинства roadmap-планирования. Команды, которые держат дисциплину на этой метрике, получают структурное преимущество над конкурентами, которые «не смогли обосновать инвестицию».

Честный лимит

Наш датасет имеет сильный сигнал по ~20 travel/hospitality командам, преимущественно в СНГ и одному EU-агрегатору. Глобальный OTA / metasearch-масштаб (Booking.com, Expedia Group, Trip.com) — вне нашего прямого наблюдения; бенчмарки для этих платформ выше взяты из опубликованных инженерных блогов, technical disclosures с earnings-звонков и датасета Phocuswright, не из нашей IDE-телеметрии. Команды на таком масштабе увидят другие формы, особенно по PNR reliability и concurrent-modification rate — их failure modes доминированы multi-region state replication challenges, которые снаружи мы не видим.

Где PanDev Metrics встраивается

Букинг-платформы на 80+ инженерах обычно организованы вокруг сервисных границ (search, booking, payment, post-booking), требующих независимого измерения. IDE heartbeat-подход различает coding time на booking-core сервисах от работы на edge-сервисах и post-booking операциях — это помогает EM увидеть, реально ли держится peak-season freeze, или «freeze»-деплои просто происходят в других репозиториях. AI-ассистент может отвечать на вопросы типа «какой процент изменений этой недели затронул PCI-scope сервисы?» — compliance-визибилити, которую ручные дашборды редко достают.

Дополнительное чтение

- Engineering Metrics in Fintech: Compliance, Speed, Security — пересекающиеся PCI и payment-integration концерны, другие failure modes

- E-Commerce: как ускорить доставку фич перед high season — seasonal-peak плейбук, у которого travel может поучиться, с более жёсткими freeze-окнами

- Marketplace Engineering: метрики для двусторонних продуктов — смежная двусторонняя динамика для OTA и meta-search

- External: IATA NDC adoption tracker — текущее состояние стандарта распределения для авиации